Các thành viên của Chương trình Đối tác YouTube sẽ có thể bảo vệ hình ảnh của mình khỏi những video “AI nhảm nhí” (AI-generated slop).

Chúng ta chưa thấy AI giải quyết các vấn đề lớn nhất của nhân loại, nhưng chúng ta đang thấy ngày càng nhiều video do AI tạo ra, bao gồm cả deepfake tinh vi. Điều này đặt ra nhu cầu về các công cụ giúp bảo vệ hình ảnh cá nhân. Hôm nay, YouTube đã chính thức ra mắt một công cụ như vậy.

YouTube Ra Mắt Công Cụ Phát Hiện Hình Ảnh Để Chống Deepfake

YouTube chính thức ra mắt công cụ phát hiện hình ảnh AI mới vào hôm nay. Tính năng này cho phép các nhà sáng tạo phát hiện các video do AI tạo ra hoặc đã bị chỉnh sửa sử dụng hình ảnh khuôn mặt của họ mà không được phép. Các nhà sáng tạo sẽ có thể quản lý và yêu cầu gỡ bỏ các video bị phát hiện.

Mục tiêu của YouTube là giúp các nhà sáng tạo bảo vệ danh tính của họ và ngăn khán giả bị đánh lừa bởi các video deepfake do AI tạo ra. Công cụ này sẽ có sẵn cho các nhà sáng tạo YouTube là thành viên của Chương trình Đối tác YouTube (YouTube Partner Program). Họ sẽ bắt đầu được cấp quyền truy cập vào tính năng này trong những tuần tới và đến tháng 1 năm 2026, tất cả các nhà sáng tạo kiếm tiền (monetized creators) sẽ có quyền truy cập.

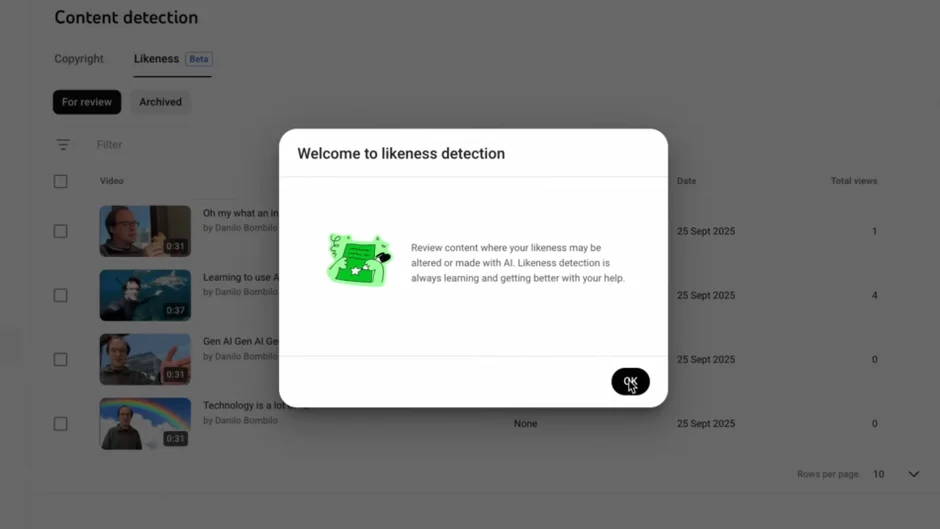

Cách Sử Dụng Công Cụ Phát Hiện Hình Ảnh

Tính năng mới này có sẵn trong tab phát hiện nội dung trong YouTube Studio. Để sử dụng, các nhà sáng tạo cần hoàn thành quy trình xác minh danh tính yêu cầu ảnh ID (giấy tờ tùy thân) và video selfie. Sau khi quá trình này hoàn tất, các nhà sáng tạo sẽ nhận được cảnh báo về tất cả các video do AI tạo ra sử dụng hình ảnh của họ.

YouTube Studio sẽ hiển thị một danh sách tất cả các video trái phép, thể hiện thông tin về kênh, tiêu đề và lượt xem của từng video. Công cụ sẽ làm nổi bật phân đoạn video nơi hình ảnh của nhà sáng tạo được sử dụng, và cho phép họ gửi yêu cầu gỡ bỏ video.

Chỉ Mới Là Khởi Đầu

Với sự gia tăng của các ứng dụng như Sora, deepfake sẽ trở thành một vấn đề ngày càng lớn đối với mọi người. YouTube đang thực hiện một bước đi đầu tiên tốt, nhưng những người nổi tiếng không phải là những người duy nhất có thể chịu ảnh hưởng từ “AI nhảm nhí” sử dụng hình ảnh của họ. Chưa kể, việc cung cấp ảnh ID và dữ liệu sinh trắc học của tôi để tự bảo vệ mình khỏi “AI nhảm nhí” nghe không hề dễ chịu.

Tôi muốn thấy nhiều hạn chế hơn đối với các video do AI tạo ra, chẳng hạn như một nguồn cấp dữ liệu riêng biệt, hoặc ít nhất là một cảnh báo rất rõ ràng rằng một clip có khả năng là giả. Điều đó sẽ không ngăn chặn deepfake, nhưng nó có thể giúp mọi người không phải mất công giải thích rằng một video là giả mạo.

Bạn có cho rằng việc YouTube yêu cầu xác minh danh tính bằng ảnh ID và selfie để truy cập công cụ bảo vệ khỏi deepfake là sự đánh đổi hợp lý giữa quyền riêng tư và an toàn nội dung không?

- Pin điện thoại của bạn giờ đây đã chính thức trở nên “thảm hại”, khi một “quái vật” 15.000mAh sắp ra mắt

- VPN by Google Có Thể Sắp Có Mặt Trên Pixel Tablet

- Samsung sắp ra mắt Galaxy Z Fold5 bản đặc biệt, cùng 7 thiết bị khác.

- Sản xuất màn hình OLED iPad Pro có thể bắt đầu vào tháng 2

- Tin đồn: Phụ kiện Apple ra mắt dự kiến vào mùa xuân năm 2024