Một bài nghiên cứu mới cho thấy Apple có những giải pháp thiết thực cho các vấn đề kỹ thuật AI. Trong khi các hãng khác dường như đang bỏ qua. Cụ thể là cách sử dụng các mô-đun ngôn ngữ lớn trên các thiết bị có bộ nhớ thấp hơn như iPhone .

Những nỗ lực cải tiến mới, không “bắt chước” Chat GPT:

Bất chấp những tuyên bố rằng Apple đứng sau ngành công nghiệp AI sáng tạo, công ty đã hai lần tiết lộ rằng họ đang tiếp tục thực hiện kế hoạch dài hạn hơn. Thay vì chạy đua để phát hành bản sao ChatGPT. Dấu hiệu đầu tiên là một bài nghiên cứu đề xuất một hệ thống AI có tên HUGS. Đây là hệ thống tạo ra hình đại diện kỹ thuật số của con người.

Hiện được phát hiện bởi VentureBeat, một bài nghiên cứu thứ hai. Trong đó đề xuất các giải pháp triển khai các mô-đun ngôn ngữ lớn (LLM) trên các thiết bị có RAM hạn chế. Chẳng hạn như iPhone.

Cơ chế của LLM

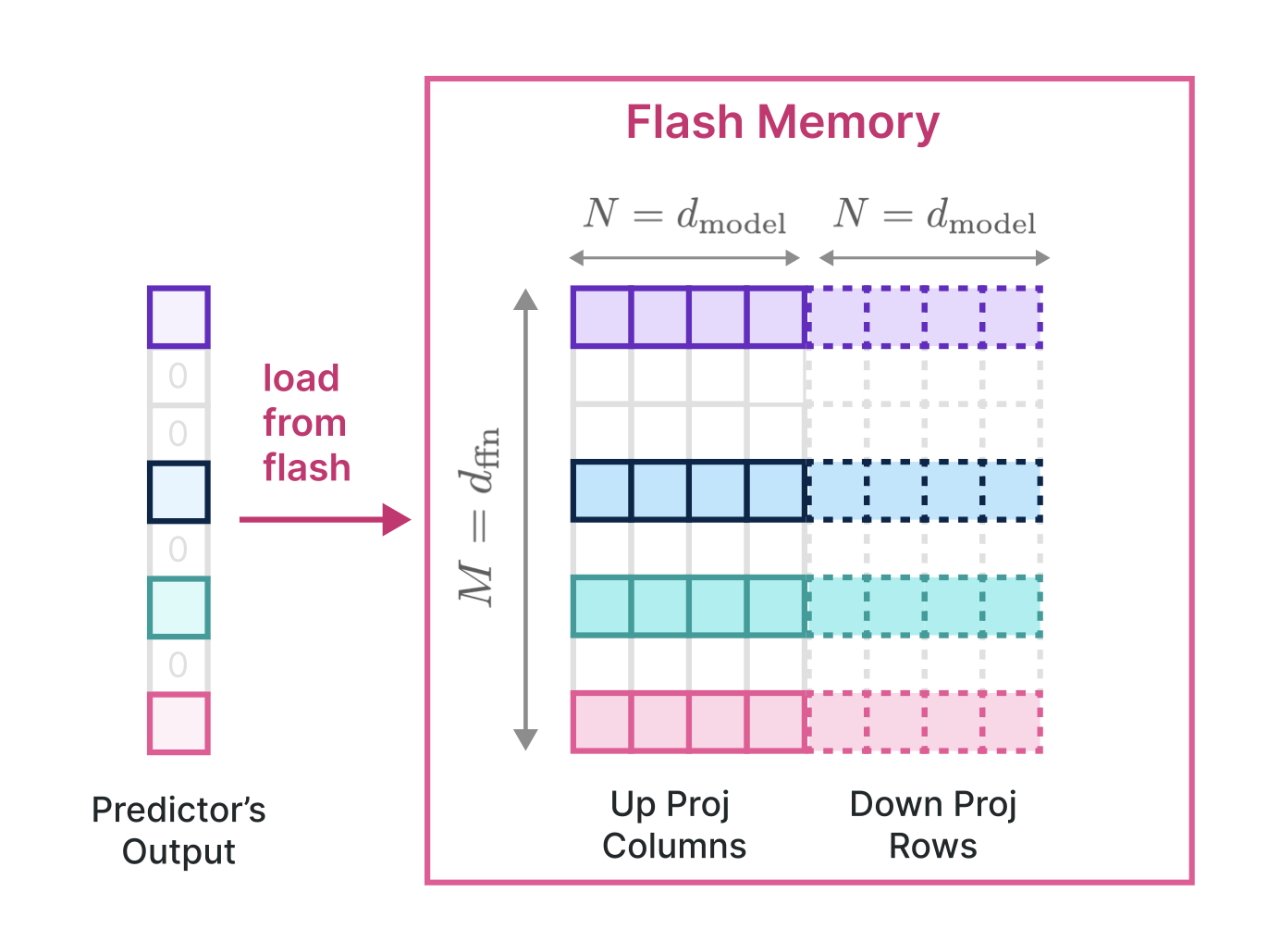

Bài báo mới có tên “LLM trong nháy mắt: Suy luận mô hình ngôn ngữ lớn hiệu quả với bộ nhớ hạn chế”. Apple cho biết họ “giải quyết thách thức chạy LLM hiệu quả vượt quá dung lượng DRAM có sẵn. Bằng cách lưu trữ các tham số mô hình trên bộ nhớ flash. Nhưng đưa chúng vào DRAM theo yêu cầu.”

Vì vậy, toàn bộ LLM vẫn cần được lưu trữ trên thiết bị. Nhưng hoạt động với nó trong RAM có thể được thực hiện thông qua hoạt động với bộ nhớ flash như một loại bộ nhớ ảo. Không khác với cách thực hiện trên macOS để thực hiện tác vụ cần nhiều bộ nhớ.

Bài nghiên cứu cho biết: “Trong khuôn khổ thông tin về bộ nhớ flash này, chúng tôi giới thiệu hai kỹ thuật chính”. “Đầu tiên, ‘cửa sổ’. Đây là cách giảm thiểu việc truyền dữ liệu một cách có chiến lược. Bằng cách sử dụng lại các nơ-ron đã kích hoạt trước đó. Và thứ hai, ‘gói hàng-cột’. Phương pháp được điều chỉnh theo cường độ truy cập dữ liệu tuần tự của bộ nhớ flash. Từ đấy làm tăng kích thước của các khối dữ liệu được đọc từ bộ nhớ flash. “

Điều này cuối cùng có nghĩa là LLM ở bất kỳ kích thước thực tế nào vẫn có thể được triển khai trên các thiết bị có bộ nhớ hoặc bộ lưu trữ hạn chế. Điều đó có nghĩa là Apple có thể tận dụng các tính năng AI trên nhiều thiết bị hơn và do đó theo nhiều cách hơn.

Kết quả thực nghiệm

“Kết quả thực tế của nghiên cứu rất đáng chú ý”, bài viết nghiên cứu khẳng định. “Chúng tôi đã chứng minh khả năng chạy LLM có kích thước gấp đôi DRAM hiện có. Đạt được tốc độ suy luận tăng gấp 4-5 lần so với các phương pháp tải truyền thống trong CPU và 20-25 lần trong GPU.”

Nó tiếp tục: “Bước đột phá này đặc biệt quan trọng để triển khai LLM tiên tiến trong môi trường hạn chế về tài nguyên. Từ đó mở rộng khả năng ứng dụng và khả năng tiếp cận của chúng”.

Apple đã công khai nghiên cứu này, giống như đã làm với bài báo HUGS. Vì vậy, thay vì tụt lại phía sau, họ thực sự đang nỗ lực cải thiện khả năng AI cho toàn ngành.

Điều này phù hợp với các nhà phân tích, những người dựa trên cơ sở người dùng như Apple. Tin rằng công ty sẽ được hưởng lợi nhiều nhất khi AI ngày càng phổ biến hơn.

Tác giả: Chaeng Dun Mpick

Tham khảo từ: MpickStudio

- Liệu T-Mobile có phải là nguyên nhân gây ra trải nghiệm nhắn tin vệ tinh “thất vọng hoàn toàn” của Starlink này?

- Apple Watch Ultra 3 có phải là một bản nâng cấp “phải có”?

- Google đang thử nghiệm một thứ có thể giết chết internet như bạn biết

- Bí mật thiết kế iPad Pro: Cây bút Apple Pencil tạo bóng như thật

- Google Gemini Sắp Có Khả Năng Phân Tích Toàn Bộ Thư Mục Mã Nguồn